Chatbots como o ChatGPT estão em ascensão: a inteligência artificial pode lidar com a ignorância natural. Cada vez mais, máquinas inteligentes são necessárias para detectar quando outras máquinas estão tentando enganar os usuários. Um comentário de Chester Wisniewski, especialista em cibersegurança da Sophos.

O chatbot ChatGPT, que é baseado em inteligência artificial, está nas manchetes do mundo todo – e além de reportagens no mercado de ações e no ambiente de direitos autorais, a segurança de TI também é foco de discussões. Apesar de todos os esforços de segurança do fabricante, a disponibilidade mais ampla e recentemente percebida da ferramenta traz consigo novos desafios quando se trata de isca de phishing ou fraude orientada por diálogo, como golpes românticos por meio de redes sociais ou ataques de comprometimento de negócios por e-mail.

Ataques comprometedores criados pela IA

“Um dos maiores riscos é que os invasores usam essas plataformas para melhorar significativamente a qualidade de suas iscas de phishing. Isso torna os ataques de phishing cada vez mais difíceis de identificar, mesmo para usuários observadores”, disse Chet Wisniewski, especialista em segurança cibernética da Sophos. “Em última análise, os chatbots de IA cada vez melhores oferecem uma atualização gratuita para todos os tipos de ataques de engenharia social. Programas como o ChatGPT podem ser usados para conduzir conversas interativas, altamente realistas e orientadas para o crime por e-mail ou lançar ataques de bate-papo via Facebook Messenger, WhatsApp ou outros aplicativos de bate-papo.

Hoje, o maior perigo é para o grupo-alvo de língua inglesa. No entanto, provavelmente é apenas uma questão de tempo até que novas versões estejam disponíveis para criar textos verossímeis em todos os idiomas comumente falados no mundo. Chegamos a um estágio em que as pessoas são cada vez mais incapazes de distinguir a prosa gerada por máquina da prosa escrita por humanos - especialmente quando não conhecemos bem a outra pessoa."

Um ponto de virada para a segurança de TI

Este desenvolvimento representa um ponto de virada para os padrões existentes na área de treinamento de funcionários e segurança de TI. Longe vão os dias em que as organizações podiam contar com funcionários para desempenhar um papel ativo na defesa contra ataques cibernéticos, observando erros gramaticais, erros de ortografia ou frases estranhas. Um dos últimos elementos eficientes dos programas de treinamento é prejudicado por chatbots como o ChatGPT - e de forma muito eficaz, como ilustram os dois exemplos a seguir.

O texto chamariz original de um golpista BEC (Business Email Compromise) que tenta canalizar o contracheque de outra pessoa para a conta do invasor é bastante fácil de identificar como "não genuíno". Em comparação, há uma variante abaixo que foi escrita inserindo os pontos-chave temáticos correspondentes do ChatGPT.

E-mail fraudulento padrão de um invasor

Oi ….,

Mudei de banco porque minha conta antiga não é mais boa para aceitar pagamento dd e gostaria de mudar meus detalhes de depósito direto em contracheque, a alteração pode ser efetivada para a data de pagamento atual?

Obrigado, ….

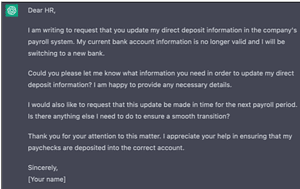

Texto escrito pelo AI ChatGPT

Prezado RH,

Estou escrevendo para solicitar que atualizem minhas informações de depósito direto no sistema de folha de pagamento da empresa. Minhas informações atuais de conta bancária não são mais válidas e irei mudar para um novo banco.

Você poderia me informar quais informações você precisa para atualizar minhas informações de depósito direto? Estou feliz em fornecer todos os detalhes necessários.

Também gostaria de solicitar que esta atualização seja feita em tempo para o próximo período da folha de pagamento. Há mais alguma coisa que preciso fazer para garantir uma transição tranquila?

Obrigado por sua atenção a este assunto. Agradeço sua ajuda para garantir que meus contracheques sejam depositados na conta correta.

Atenciosamente,

[Seu nome]

"O exemplo soa como o e-mail de uma pessoa real, tem boa pontuação, ortografia e gramática. ela é perfeita Não. ela é boa o suficiente? Em todo o caso! Com os golpistas já ganhando milhões com seus chamarizes mal elaborados, é fácil imaginar a nova dimensão dessa comunicação impulsionada por IA. Imagine conversar com este bot via WhatsApp ou Microsoft Teams. Eles teriam reconhecido a máquina?” Wisniewski diz sobre seu “trabalho criativo” com o chatbot.

Assine a newsletter agora

Leia as melhores notícias de B2B CYBER SECURITY uma vez por mêsAIs podem enganar os usuários quase perfeitamente

O fato é que quase todos os tipos de aplicativos no campo da IA já chegaram a um ponto em que podem enganar um ser humano quase 100% das vezes. A qualidade da “conversação” que se pode ter com o ChatGPT é notável, e a capacidade de gerar falsos rostos humanos quase indistinguíveis (para humanos) de fotos reais, por exemplo, também já é uma realidade. O potencial criminoso dessas tecnologias é imenso, como um exemplo deixa claro: os criminosos que desejam realizar fraudes por meio de uma empresa de fachada simplesmente geram 25 rostos e usam o ChatGPT para escrever suas biografias. Adicione algumas contas falsas do LinkedIn e pronto.

Por outro lado, o "lado bom" também deve se voltar para a tecnologia para poder enfrentá-la. “Todos nós precisamos vestir nossos trajes do Homem de Ferro se quisermos enfrentar as águas cada vez mais perigosas da internet”, disse Wisniewski. “Cada vez mais parece que precisamos de máquinas para detectar quando outras máquinas estão tentando nos enganar. Uma prova de conceito interessante foi desenvolvida pelo Hugging Face, que pode reconhecer texto gerado com GPT-2 - sugerindo que técnicas semelhantes poderiam ser usadas para reconhecer a saída GPT-3.”

Triste, mas é verdade: a IA colocou o prego final no caixão da conscientização de segurança do usuário final.

“Estou dizendo que devemos parar com isso completamente? Não, mas temos que diminuir nossas expectativas. Certamente não custa seguir as melhores práticas em termos de segurança de TI que foram e ainda são aplicáveis. Precisamos encorajar os usuários a serem ainda mais desconfiados do que antes e, mais importante, verificar escrupulosamente as mensagens que contêm acesso a informações pessoais ou itens monetários. Trata-se de fazer perguntas, pedir ajuda e dedicar aqueles poucos momentos extras necessários para confirmar que as coisas realmente são como parecem. Não é paranóia, é uma vontade de não ser enganado pelos bandidos.”

Mais em Sophos.com

Sobre a Sophos A Sophos tem a confiança de mais de 100 milhões de usuários em 150 países. Oferecemos a melhor proteção contra ameaças complexas de TI e perda de dados. Nossas soluções de segurança abrangentes são fáceis de implantar, usar e gerenciar. Eles oferecem o menor custo total de propriedade do setor. A Sophos oferece soluções de criptografia premiadas, soluções de segurança para endpoints, redes, dispositivos móveis, e-mail e web. Também há suporte da SophosLabs, nossa rede global de centros de análise proprietários. A sede da Sophos fica em Boston, EUA e Oxford, Reino Unido.