I chatbot come ChatGPT sono in aumento: l'intelligenza artificiale può far fronte all'ignoranza naturale. Sono sempre più necessarie macchine intelligenti per rilevare quando altre macchine cercano di ingannare gli utenti. Un commento di Chester Wisniewski, esperto di sicurezza informatica di Sophos.

Il chatbot ChatGPT, basato sull'intelligenza artificiale, sta facendo notizia in tutto il mondo e, oltre ai rapporti sul mercato azionario e sull'ambiente dei diritti d'autore, anche la sicurezza IT è al centro delle discussioni. Nonostante tutti gli sforzi di sicurezza del produttore, la disponibilità più ampia e recentemente realizzata dello strumento porta con sé nuove sfide quando si tratta di esche di phishing o frodi orientate al dialogo come truffe romantiche tramite social network o attacchi di compromissione orientati al business tramite e-mail.

Attacchi compromettenti ideati dall'IA

“Uno dei maggiori rischi è che gli aggressori utilizzino queste piattaforme per migliorare significativamente la qualità delle loro esche di phishing. Ciò rende gli attacchi di phishing sempre più difficili da identificare, anche per gli utenti attenti", ha dichiarato Chet Wisniewski, esperto di sicurezza informatica di Sophos. “In definitiva, i chatbot AI in continua evoluzione offrono un aggiornamento gratuito per tutti i tipi di attacchi di ingegneria sociale. Programmi come ChatGPT possono essere utilizzati per condurre conversazioni interattive orientate alla criminalità, altamente realistiche via e-mail o lanciare attacchi di chat tramite Facebook Messenger, WhatsApp o altre app di chat.

Oggi il pericolo maggiore è per il gruppo target di lingua inglese. Tuttavia, è probabilmente solo una questione di tempo prima che siano disponibili nuove versioni per creare testi credibili in tutte le lingue comunemente parlate nel mondo. Abbiamo raggiunto uno stadio in cui le persone sono sempre più incapaci di distinguere la prosa generata dalla macchina dalla prosa scritta dall'uomo, specialmente quando non conosciamo bene l'altra persona".

Una svolta per la sicurezza informatica

Questo sviluppo rappresenta un punto di svolta per gli standard esistenti nel settore della formazione dei dipendenti e della sicurezza informatica. Sono finiti i giorni in cui le organizzazioni potevano affidarsi ai dipendenti per svolgere un ruolo attivo nella difesa dagli attacchi informatici controllando errori grammaticali, di ortografia o frasi strane. Uno degli ultimi elementi efficienti dei programmi di formazione è minato da chatbot come ChatGPT e in modo molto efficace, come illustrano i due esempi seguenti.

Il testo esca originale di un truffatore BEC (Business Email Compromise) che tenta di incanalare lo stipendio di qualcun altro sull'account dell'attaccante è abbastanza facile da individuare come "non autentico". In confronto, c'è una variante qui sotto che è stata scritta inserendo i corrispondenti punti chiave tematici di ChatGPT.

Email di truffa predefinita da un utente malintenzionato

CIAO ….,

Ho cambiato le mie banche perché il mio vecchio conto non è più idoneo ad accettare il pagamento gg e vorrei modificare i dettagli del deposito diretto della mia busta paga, la modifica può essere effettiva per la data di pagamento corrente?

Grazie, ….

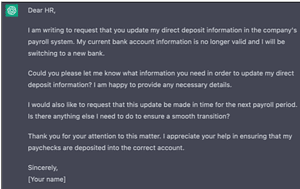

Testo scritto dall'AI ChatGPT

Caro HR,

Ti scrivo per chiederti di aggiornare i dati del mio deposito diretto nel sistema di buste paga dell'azienda.I dati del mio conto corrente bancario non sono più validi e passerò a una nuova banca.

Potresti farmi sapere di quali informazioni hai bisogno per aggiornare le mie informazioni sul deposito diretto? Sono felice di fornire tutti i dettagli necessari.

Vorrei anche richiedere che questo aggiornamento venga effettuato in tempo per il prossimo periodo di gestione stipendi. C'è qualcos'altro che devo fare per garantire una transizione graduale?

Grazie per la vostra attenzione a questa questione. Apprezzo il tuo aiuto nel garantire che i miei stipendi siano depositati sul conto corretto.

Cordiali saluti,

[Il tuo nome]

"L'esempio suona come l'e-mail di una persona reale, ha una buona punteggiatura, ortografia e grammatica. lei è perfetta NO. lei è abbastanza brava? Comunque! Con i truffatori che già guadagnano milioni con le loro esche mal realizzate, è facile immaginare la nuova dimensione di questa comunicazione spinta dall'intelligenza artificiale. Immagina di chattare con questo bot tramite WhatsApp o Microsoft Teams. Avrebbero riconosciuto la macchina?", dice Wisniewski a proposito del suo "lavoro creativo" con il chatbot.

Iscriviti alla newsletter ora

Leggi le migliori notizie da B2B CYBER SECURITY una volta al meseLe IA possono ingannare gli utenti quasi perfettamente

Il fatto è che quasi tutti i tipi di applicazioni nel campo dell'IA hanno già raggiunto un punto in cui possono ingannare un essere umano quasi il 100% delle volte. La qualità della “conversazione” che si può avere con ChatGPT è notevole, e la capacità di generare finti volti umani quasi indistinguibili (per gli umani) da foto reali, per esempio, è già una realtà. Il potenziale criminale di tali tecnologie è immenso, come chiarisce un esempio: i criminali che vogliono compiere frodi tramite una società di comodo generano semplicemente 25 volti e usano ChatGPT per scrivere le loro biografie. Aggiungi alcuni account LinkedIn falsi e sei a posto.

Al contrario, anche il "lato buono" deve rivolgersi alla tecnologia per poter resistere. "Dobbiamo tutti indossare le nostre tute di Iron Man se vogliamo sfidare le acque sempre più pericolose di Internet", ha detto Wisniewski. “Sembra sempre più che abbiamo bisogno di macchine per rilevare quando altre macchine stanno cercando di ingannarci. Un'interessante prova di concetto è stata sviluppata da Hugging Face, che può riconoscere il testo generato con GPT-2, suggerendo che tecniche simili potrebbero essere utilizzate per riconoscere l'output GPT-3".

Triste ma vero: l'intelligenza artificiale ha messo l'ultimo chiodo nella bara della consapevolezza della sicurezza degli utenti finali.

“Sto dicendo che dovremmo smetterla del tutto? No, ma dobbiamo abbassare le nostre aspettative. Non guasta certo seguire le best practice in tema di sicurezza informatica che sono state e spesso sono tuttora applicabili. Dobbiamo incoraggiare gli utenti a essere ancora più sospettosi di prima e, soprattutto, a controllare scrupolosamente i messaggi che contengono l'accesso a informazioni personali o elementi monetari. Si tratta di fare domande, chiedere aiuto e prendersi quei pochi momenti di tempo extra necessari per confermare che le cose sono davvero come sembrano. Non è paranoia, è volontà di non essere derubato dai truffatori.

Maggiori informazioni su Sophos.com

A proposito di Sophos Sophos gode della fiducia di oltre 100 milioni di utenti in 150 paesi. Offriamo la migliore protezione contro le minacce informatiche complesse e la perdita di dati. Le nostre soluzioni di sicurezza complete sono facili da implementare, utilizzare e gestire. Offrono il costo totale di proprietà più basso del settore. Sophos offre soluzioni di crittografia pluripremiate, soluzioni di sicurezza per endpoint, reti, dispositivi mobili, e-mail e web. C'è anche il supporto dei SophosLabs, la nostra rete globale di centri di analisi proprietari. Le sedi di Sophos sono a Boston, USA e Oxford, UK.