Los chatbots como ChatGPT están en auge: la inteligencia artificial puede hacer frente a la ignorancia natural. Cada vez más, se necesitan máquinas inteligentes para detectar cuándo otras máquinas intentan engañar a los usuarios. Un comentario de Chester Wisniewski, experto en ciberseguridad de Sophos.

El chatbot ChatGPT, que se basa en inteligencia artificial, está en los titulares de todo el mundo, y además de los informes en el mercado de valores y el entorno de derechos de autor, la seguridad de TI también es el centro de las discusiones. A pesar de todos los esfuerzos de seguridad del fabricante, la disponibilidad más amplia y recientemente realizada de la herramienta trae consigo nuevos desafíos cuando se trata de cebo de phishing o fraude orientado al diálogo, como estafas románticas a través de redes sociales o ataques de compromiso orientados a negocios a través de correo electrónico.

Ataques comprometedores ideados por la IA

“Uno de los mayores riesgos es que los atacantes utilicen estas plataformas para mejorar significativamente la calidad de sus señuelos de phishing. Esto hace que los ataques de phishing sean cada vez más difíciles de identificar, incluso para los usuarios observadores”, dijo Chet Wisniewski, experto en ciberseguridad de Sophos. “En última instancia, los chatbots de IA en constante mejora ofrecen una actualización gratuita para todo tipo de ataques de ingeniería social. Los programas como ChatGPT se pueden usar para llevar a cabo conversaciones interactivas altamente realistas y de orientación criminal por correo electrónico o lanzar ataques de chat a través de Facebook Messenger, WhatsApp u otras aplicaciones de chat.

Hoy, el mayor peligro es para el grupo objetivo de habla inglesa. Sin embargo, probablemente sea solo cuestión de tiempo antes de que haya nuevas versiones disponibles para crear textos creíbles en todos los idiomas comúnmente hablados en el mundo. Hemos llegado a una etapa en la que las personas son cada vez más incapaces de distinguir la prosa generada por máquinas de la prosa escrita por humanos, especialmente cuando no conocemos bien a la otra persona".

Un punto de inflexión para la seguridad informática

Este desarrollo representa un punto de inflexión para los estándares existentes en el área de capacitación de empleados y seguridad de TI. Atrás quedaron los días en que las organizaciones podían confiar en que los empleados desempeñaran un papel activo en la defensa contra los ataques cibernéticos al observar errores gramaticales, errores ortográficos o frases extrañas. Uno de los últimos elementos eficientes de los programas de capacitación se ve socavado por chatbots como ChatGPT, y de manera muy efectiva, como ilustran los siguientes dos ejemplos.

El texto señuelo original de un estafador BEC (Compromiso de correo electrónico comercial) que intenta canalizar el cheque de pago de otra persona a la cuenta del atacante es bastante fácil de detectar como "no genuino". En comparación, hay una variante a continuación que se escribió ingresando los puntos clave temáticos correspondientes de ChatGPT.

Correo electrónico de estafa predeterminado de un atacante

Hola ….,

Cambié de banco porque mi cuenta anterior ya no es válida para aceptar el pago dd y me gustaría cambiar los detalles de depósito directo de mi cheque de pago, ¿puede el cambio ser efectivo para la fecha de pago actual?

Gracias, ….

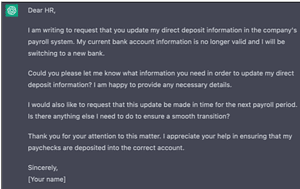

Texto escrito por el AI ChatGPT

Estimado RRHH,

Le escribo para solicitarle que actualice mi información de depósito directo en el sistema de nómina de la compañía. La información de mi cuenta bancaria actual ya no es válida y me cambiaré a un nuevo banco.

¿Podría decirme qué información necesita para actualizar mi información de depósito directo? Estoy feliz de proporcionar los detalles necesarios.

También me gustaría solicitar que esta actualización se realice a tiempo para el próximo período de nómina. ¿Hay algo más que deba hacer para garantizar una transición sin problemas?

Gracias por su atención a este asunto. Agradezco su ayuda para garantizar que mis cheques de pago se depositen en la cuenta correcta.

Atentamente,

[Tu nombre]

"El ejemplo suena como el correo electrónico de una persona real, tiene buena puntuación, ortografía y gramática. ella es perfecta No. ¿Es ella lo suficientemente buena? ¡En todo caso! Con los estafadores que ya ganan millones con sus señuelos mal elaborados, es fácil imaginar la nueva dimensión de esta comunicación impulsada por IA. Imagina chatear con este bot a través de WhatsApp o Microsoft Teams. ¿Habrían reconocido la máquina?”, dice Wisniewski sobre su “trabajo creativo” con el chatbot.

Suscríbete al boletín ahora

Lea las mejores noticias de SEGURIDAD CIBERNÉTICA B2B una vez al mesLas IA pueden engañar a los usuarios casi a la perfección

El hecho es que casi todos los tipos de aplicaciones en el campo de la IA ya han llegado a un punto en el que pueden engañar a un humano casi el 100% de las veces. La calidad de la "conversación" que se puede tener con ChatGPT es notable, y la capacidad de generar rostros humanos falsos que son casi indistinguibles (para los humanos) de fotos reales, por ejemplo, también es ya una realidad. El potencial delictivo de tales tecnologías es inmenso, como lo deja claro un ejemplo: los delincuentes que desean cometer fraude a través de una empresa ficticia simplemente generan 25 rostros y usan ChatGPT para escribir sus biografías. Agrega algunas cuentas falsas de LinkedIn y listo.

Por el contrario, el "lado bueno" también debe recurrir a la tecnología para poder hacerle frente. “Todos debemos ponernos nuestros trajes de Iron Man si vamos a desafiar las aguas cada vez más peligrosas de Internet”, dijo Wisniewski. “Parece cada vez más que necesitamos máquinas para detectar cuándo otras máquinas están tratando de engañarnos. Hugging Face desarrolló una prueba de concepto interesante, que puede reconocer el texto generado con GPT-2, lo que sugiere que se podrían usar técnicas similares para reconocer la salida de GPT-3”.

Triste pero cierto: AI ha puesto el último clavo en el ataúd de la conciencia de seguridad del usuario final.

“¿Estoy diciendo que deberíamos detener esto por completo? No, pero tenemos que bajar nuestras expectativas. Ciertamente, no está de más seguir las mejores prácticas en términos de seguridad de TI que han sido y, a menudo, siguen siendo aplicables. Necesitamos alentar a los usuarios a desconfiar aún más que antes y, lo que es más importante, a revisar escrupulosamente los mensajes que contienen acceso a información personal o elementos monetarios. Se trata de hacer preguntas, pedir ayuda y tomarse esos momentos de tiempo extra necesarios para confirmar que las cosas realmente son lo que parecen. No es paranoia, es la voluntad de no ser estafado por los ladrones”.

Más en Sophos.com

Acerca de Sophos Sophos cuenta con la confianza de más de 100 millones de usuarios en 150 países. Ofrecemos la mejor protección contra amenazas informáticas complejas y pérdida de datos. Nuestras soluciones integrales de seguridad son fáciles de implementar, usar y administrar. Ofrecen el costo total de propiedad más bajo de la industria. Sophos ofrece soluciones de cifrado galardonadas, soluciones de seguridad para terminales, redes, dispositivos móviles, correo electrónico y web. También cuenta con el soporte de SophosLabs, nuestra red global de centros de análisis patentados. Las oficinas centrales de Sophos se encuentran en Boston, EE. UU. y Oxford, Reino Unido.