Les chatbots comme ChatGPT ont le vent en poupe : l'intelligence artificielle peut faire face à l'ignorance naturelle. De plus en plus, des machines intelligentes sont nécessaires pour détecter quand d'autres machines essaient de tromper les utilisateurs. Un commentaire de Chester Wisniewski, expert en cybersécurité chez Sophos.

Le chatbot ChatGPT, basé sur l'intelligence artificielle, fait la une des journaux dans le monde entier - et en plus des rapports sur le marché boursier et l'environnement du droit d'auteur, la sécurité informatique est également au centre des discussions. Malgré tous les efforts de sécurité du fabricant, la disponibilité plus large et récemment réalisée de l'outil apporte de nouveaux défis en ce qui concerne les appâts de phishing ou les fraudes axées sur le dialogue, telles que les escroqueries amoureuses via les réseaux sociaux ou les attaques commerciales par e-mail.

Attaques compromettantes conçues par l'IA

"L'un des plus grands risques est que les attaquants utilisent ces plates-formes pour améliorer considérablement la qualité de leurs leurres de phishing. Cela rend les attaques de phishing de plus en plus difficiles à identifier, même pour les utilisateurs attentifs », a déclaré Chet Wisniewski, expert en cybersécurité chez Sophos. "En fin de compte, les chatbots IA en constante amélioration offrent une mise à niveau gratuite pour toutes sortes d'attaques d'ingénierie sociale. Des programmes comme ChatGPT peuvent être utilisés pour mener des conversations interactives très réalistes à caractère criminel par e-mail ou lancer des attaques par chat via Facebook Messenger, WhatsApp ou d'autres applications de chat.

Aujourd'hui, le plus grand danger concerne le groupe cible anglophone. Cependant, ce n'est probablement qu'une question de temps avant que de nouvelles versions soient disponibles pour créer des textes crédibles dans toutes les langues couramment parlées dans le monde. Nous avons atteint un stade où les gens sont de plus en plus incapables de distinguer la prose générée par la machine de la prose écrite par l'homme - surtout lorsque nous ne connaissons pas bien l'autre personne."

Un tournant pour la sécurité informatique

Cette évolution représente un tournant pour les normes existantes dans le domaine de la formation des employés et de la sécurité informatique. L'époque où les organisations pouvaient compter sur leurs employés pour jouer un rôle actif dans la défense contre les cyberattaques en surveillant les erreurs grammaticales, les fautes d'orthographe ou les formulations étranges est révolue. L'un des derniers éléments efficaces des programmes de formation est mis à mal par les chatbots comme ChatGPT - et très efficacement, comme l'illustrent les deux exemples suivants.

Le texte leurre original d'un escroc BEC (Business Email Compromise) tentant de canaliser le chèque de paie de quelqu'un d'autre vers le compte de l'attaquant est assez facile à repérer comme "non authentique". En comparaison, il existe une variante ci-dessous qui a été écrite en saisissant les points clés thématiques correspondants de ChatGPT.

E-mail frauduleux par défaut d'un attaquant

Salut ….,

J'ai changé de banque parce que mon ancien compte n'est plus prêt à accepter le paiement dd et j'aimerais changer les détails de mon dépôt direct de chèque de paie, le changement peut-il être effectif pour la date de paiement actuelle ?

Merci, ….

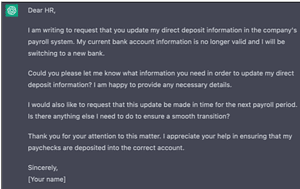

Texte rédigé par l'IA ChatGPT

Cher RH,

Je vous écris pour vous demander de mettre à jour mes informations de dépôt direct dans le système de paie de l'entreprise. Les informations de mon compte bancaire actuel ne sont plus valides et je vais changer de banque.

Pourriez-vous s'il vous plaît me faire savoir de quelles informations vous avez besoin pour mettre à jour mes informations de dépôt direct ? Je suis heureux de fournir tous les détails nécessaires.

Je voudrais également demander que cette mise à jour soit effectuée à temps pour la prochaine période de paie. Dois-je faire autre chose pour assurer une transition en douceur ?

Merci de votre attention à cette question. J'apprécie votre aide pour m'assurer que mes chèques de paie sont déposés dans le bon compte.

Sincèrement,

[Votre nom]

"L'exemple ressemble à l'e-mail d'une personne réelle, a une bonne ponctuation, orthographe et grammaire. est-elle parfaite Non. est-elle assez bonne ? Dans tous les cas! Les escrocs gagnant déjà des millions grâce à leurs leurres mal conçus, il est facile d'imaginer la nouvelle dimension de cette communication poussée par l'IA. Imaginez discuter avec ce bot via WhatsApp ou Microsoft Teams. Auraient-ils reconnu la machine ? », déclare Wisniewski à propos de son « travail créatif » avec le chatbot.

Abonnez-vous à la newsletter maintenant

Lisez les meilleures nouvelles de B2B CYBER SECURITY une fois par moisLes IA peuvent tromper les utilisateurs presque parfaitement

Le fait est que presque tous les types d'applications dans le domaine de l'IA ont déjà atteint un point où elles peuvent tromper un humain presque 100 % du temps. La qualité de la "conversation" que l'on peut avoir avec ChatGPT est remarquable, et la capacité de générer de faux visages humains qui sont presque impossibles à distinguer (pour les humains) des vraies photos, par exemple, est également déjà une réalité. Le potentiel criminel de ces technologies est immense, comme le montre un exemple : les criminels qui veulent commettre une fraude via une société écran génèrent simplement 25 visages et utilisent ChatGPT pour écrire leurs biographies. Ajoutez quelques faux comptes LinkedIn et vous êtes prêt à partir.

A l'inverse, le "bon côté" doit aussi se tourner vers la technologie pour pouvoir lui tenir tête. "Nous devons tous enfiler nos combinaisons Iron Man si nous voulons braver les eaux de plus en plus dangereuses d'Internet", a déclaré Wisniewski. "Il semble de plus en plus que nous ayons besoin de machines pour détecter quand d'autres machines essaient de nous tromper. Une preuve de concept intéressante a été développée par Hugging Face, qui peut reconnaître le texte généré avec GPT-2 - suggérant que des techniques similaires pourraient être utilisées pour reconnaître la sortie GPT-3.

Triste mais vrai : l'IA a mis le dernier clou dans le cercueil de la sensibilisation à la sécurité des utilisateurs finaux.

« Suis-je en train de dire que nous devrions arrêter cela complètement ? Non, mais nous devons réduire nos attentes. Cela ne fait certainement pas de mal de suivre les meilleures pratiques en matière de sécurité informatique qui ont été et sont souvent encore applicables. Nous devons encourager les utilisateurs à être encore plus méfiants qu'auparavant et, surtout, à vérifier scrupuleusement les messages contenant l'accès à des informations personnelles ou à des éléments monétaires. Il s'agit de poser des questions, de demander de l'aide et de prendre ces quelques instants supplémentaires nécessaires pour confirmer que les choses sont vraiment ce qu'elles semblent être. Ce n'est pas de la paranoïa, c'est une volonté de ne pas se faire arnaquer par les escrocs.

Plus sur Sophos.com

À propos de Sophos Plus de 100 millions d'utilisateurs dans 150 pays font confiance à Sophos. Nous offrons la meilleure protection contre les menaces informatiques complexes et la perte de données. Nos solutions de sécurité complètes sont faciles à déployer, à utiliser et à gérer. Ils offrent le coût total de possession le plus bas du secteur. Sophos propose des solutions de chiffrement primées, des solutions de sécurité pour les terminaux, les réseaux, les appareils mobiles, la messagerie et le Web. Vous bénéficiez également de l'assistance des SophosLabs, notre réseau mondial de centres d'analyse propriétaires. Le siège social de Sophos se trouve à Boston, aux États-Unis, et à Oxford, au Royaume-Uni.